ИИ повысит количество и уровень кибератак

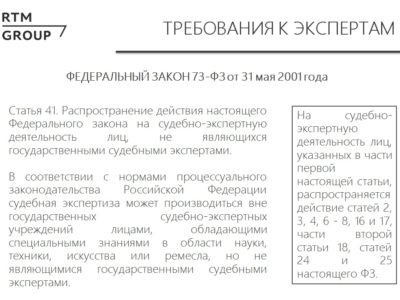

Сегодня искусственный интеллект (ИИ) используется примерно в 1% кибератак, но уже в ближайшие 10 лет этот показатель преодолеет 10%.

ИИ в атаке – это генерация dorks.

Dorks — хакерский метод, при котором используется расширенная сеть запросов, чтобы добраться до какой-то скрытой информации.

Google Dork, например, позволяет находить информацию, которая может быть скрыта или недоступна для обычных пользователей. Можно найти пароли, личные данные, уязвимости в системах безопасности и другие интересные вещи.

ИИ научился эффективно строить дорки – порой, даже лучше, чем люди.

Также ИИ активно используется для генерации вредоносного кода.

Что хакеры делали раньше — добавляли паразитные кусочки кода, которые антивирусы не сразу, но блокировали. Сейчас появляются нейросети, которые позволяют переписывать и переупаковывать код и использовать его в атаках.

Таким образом, ИИ «скрывает» вредоносный код от средств защиты.

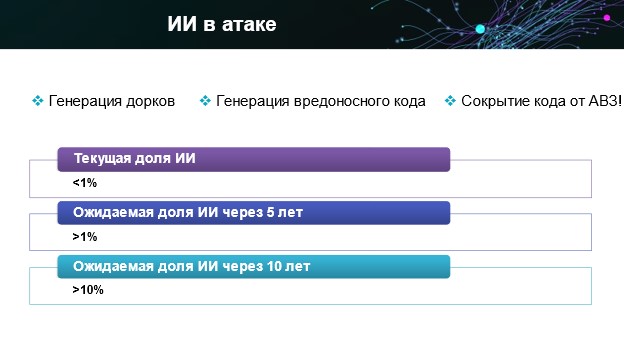

Применение искусственного интеллекта в социальной инженерии

Применение искусственного интеллекта в социнженерии вырастет c 1% до 40% в ближайшие 10 лет.

Откуда ждать рост? Активное создание правдоподобных рекламных объявлений, электронных писем и других сообщений.

Помимо целевого фишинга, ИИ также способен генерировать документы, с помощью которых хакеры смогут выдавать себя за партнеров или коллег своей жертвы, имитируя их стиль. И автоматизировать шпионаж, например собирать данные об онлайн-активностях пользователя — публикациях в соцсетях, комментариях и собственных статьях.

Злоумышленники будут обрабатывать такую информацию и на ее основе создавать текстовые и аудио фейки, имитируя индивидуальный стиль и голос человека.

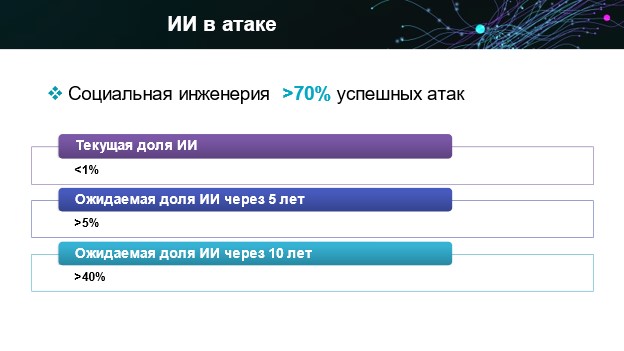

Большая проблема для этих 2 областей применения – этическая. А вот правовая часть для киберпреступлений прописана относительно неплохо.

Тенденции применения искусственного интеллекта

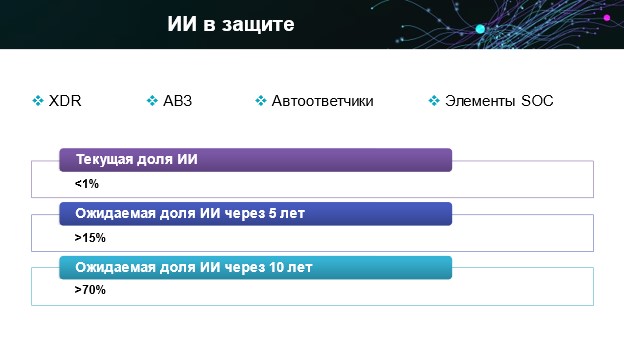

В киберзащите ИИ решает важные задачи и его применение будет только расти.

Через 10 лет ИИ будет применяться более чем в 70% случаев.

Уже сейчас поставщики, например, систем расширенного обнаружения и реагирования (extended detection and response, XDR) успешно используют ИИ для выявления и предотвращения угроз, что помогает киберзащитникам устранять различные проблемы, такие как анонимные хакерские атаки, и совершенствовать процессы защиты.

Проблема — отсутствие правовой базы для самостоятельной работы ИИ. Не хватает терминологии, системы правовых принципов, норм и правил, регламентирующих использование или взаимодействие с нейросетями.

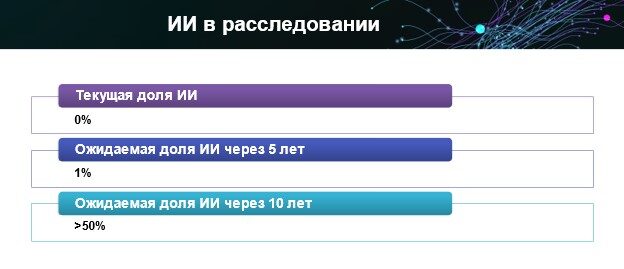

Искусственный интеллект в экспертизах

Что касается направления судебных экспертиз, ждем роста применения более чем в 40% через несколько лет.

ИИ, с его способностью быстро и точно анализировать огромные объемы данных, способен сильно изменить рынок судебных экспертиз. Искусственный интеллект может применяться для идентификации отпечатков пальцев и распознавания лиц. Это не только быстрее ручной работы, но и снижает вероятность человеческой ошибки.

Более того, он будет играть решающую роль в цифровой криминалистике, в исследованиях цифровых устройств и сетей.

ИИ может помочь обнаружить закономерности и аномалии в больших объемах цифровых данных, упрощая выявление потенциальных доказательств.

Например, проанализировать историю подозреваемого в Интернете или его активность в социальных сетях, чтобы найти улики, которые могут быть упущены следователями-людьми.

Проблема — воспроизводимость результатов. Если эксперт проводит исследование и получает определенный результат, то другой эксперт, используя те же методы и материалы, должен получить тот же результат. Это гарантирует точность и объективность исследований и уменьшает вероятность ошибок.

И этого невозможно ожидать от ИИ, который непрерывно учится и совершенствуется. Результаты экспертиз, проводимых при помощи искусственного интеллекта, будут постоянно улучшаться.

И тут придется не просто править правовое регулирование, его придется полностью переделывать.

Законодательная база должна сформулировать принципы принятия и оценки окончательного решения, основанного на результатах применения алгоритмов ИИ. Только в таком случае мы придем к экспертизам, проводимым с помощью искусственного интеллекта, и, наконец, нагоним преступников в этой битве снаряда и брони.

Автор статьи: Царев Евгений